こんにちは!

現役パラレルワーカー フクコです。

前回の記事↓に続き

来年の2月の試験に向けてE資格試験勉強中のため

E資格とは?の記事はコチラ↓

ゼロつくシリーズでおなじみ

オーライリーから出版されている

ディープラーニングの本格的な入門書でよくおススメされる

「ゼロからつくる Deep Learning」本

この本↑を毎日5ページずつコツコツこなすと

約2か月間で今年中に終了するので

来年のE資格試験までにこれで基礎力をつけることにしました。(^^)

ついつい私は何もないとだらけてしまうので(笑)

毎日5ページ終わった後の記録とまとめを書いていこうと思います。

と、まとめに入る前に…

やる気を出すためのコトバをシェアします!!(主に私のやる気を出すために 笑)

人間は幸せを希望を求める。

しかし不思議だ 絶望こそ人間を育てる。

by レウウィス大公

私の大好きな「約束のネバーランド」(約ネバ)から

レウウィス大公の名言です。

レウウィス大公は、主人公エマ達の敵、鬼の王家出身で五男坊。

1000年以上生きていて、

かつて人間と鬼の命を懸けた狩り合いを懐かしんだり、

フェアプレイを好む風変わりな鬼がヒトに対していう一言なんですが…

そうなんですよね!

どんなに幸せで、楽しくても

そこから何かを学ぶことってないですよね。

だって…

幸せを感じてるときって、現状に満足しちゃっている

ってことなんですから。

ヒトは足りないとか、悔しいとか、絶望している時の方が

努力を継続して、頑張ることができるんですよね!

レウウィス大公、どうもありがとう! (^0^)

今日もやる気が出てきました!

よし!! 今日も頑張るぞ~! お~!!

というコトで、

今日も、へっぽこなままできないのはくやしいので、私はノルマをこなしますよ! 笑

ではでは、いい加減まとめに入ります。笑

その前に本の目次の紹介です。

ゼロつくディープラーニングは、下記↓の合計8章で構成されています。

本の目次

- 1章 Python入門

- 2章 パーセプトロン

- 3章 ニューラルネットワーク

- 4章 ニューラルネットワークの学習

- 5章 誤差伝播法

- 6章 学習に関するテクニック

- 7章 畳み込みニューラルネットワーク

- 8章 ディープラーニング

ちなみに…

ゼロつくディープラーニングの第1章はPython入門のセクション(20ページ分)なので、

とりあえず今回私は飛ばし、第2章からまとめています。

今日から、第7章で~す。

第7章 畳み込みニューラルネットワーク

第7章のテーマは、

畳み込みニューラルネットワーク(Convolutional Neural Network: CNN)。

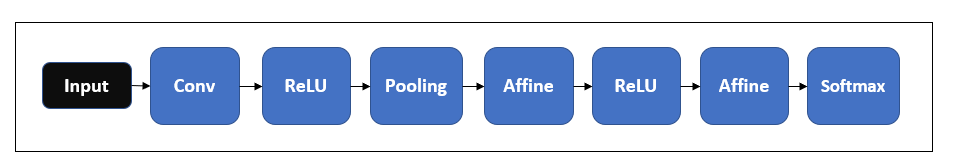

7.1 全体の構造

CNNも

これまで見てきたニューラルネットワークと同じ。

レゴのようにレイヤを組み合わせて作ることができる。

ただし、

CNNは、

「Convolution」レイヤ(畳み込み層)と「Pooling」レイヤが登場する。

隣接するニューロン間の結合を、「全結合」という。

↓の図が畳み込みニューラルネットワーク(CNN)の例。

CNNでは、

Convolution ー ReLU ー Poolingに置き換わった。

出力に近い層は、これまで同様 Affine ー ReLU、

最後の出力層においては、Affine ー Softmaxの組み合わせが用いられる。

7.2.1 全結合層の問題点

全結合層の問題点とは??

それは、

データの形状が無視されてしまうコト。

一方、

畳み込み層(Convolution)レイヤは、

形状を維持する。

CNNでは、

畳み込み層の入出力データを、特徴マップという場合がある。

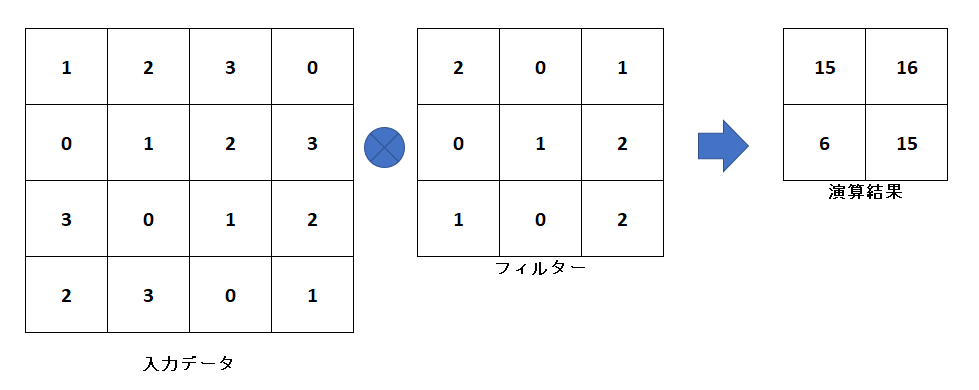

7.2.2 畳み込み演算

畳み込み層で行う処理は、

「畳み込み演算」。

ちなみに、

フィルターは、カーネルと呼ばれることもある。

畳み込み演算の例↓を

↓の入力データとフィルターを使って計算してみると

たとえば…

(1x2)+(2x0)+(3x1)+(0x0)+(1x1)+(2x2)+(3x1)+(0x0)+(1x2) = 15 ↓の左上の演算結果

今日のまとめ

ハイ、今日はここまで!!

やっと第7章に突入です!

今日はページ数のわりにあまり進んでない気分。。。

引き続き頑張りまっす。

最後まで読んでくださり、ありがとうございます!

フクコ

ディープラーニング入門書おススメ本

E資格とは?