こんにちは!

現役パラレルワーカー フクコです。

前回の記事↓に続き

www.fukuko-parallel-work.com

来年の2月の試験に向けてE資格試験勉強中のため

E資格とは?の記事はコチラ↓

ゼロつくシリーズでおなじみ

オーライリーから出版されている

ディープラーニングの本格的な入門書でよくおススメされる

「ゼロからつくる Deep Learning」本

この本↑を毎日5ページずつコツコツこなすと

約2か月間で今年中に終了するので

来年のE資格試験までにこれで基礎力をつけることにしました。(^^)

ついつい私は何もないとだらけてしまうので(笑)

毎日5ページ終わった後の記録とまとめを書いていこうと思います。

と、まとめに入る前に…

やる気を出すためのコトバをシェアします!!(主に私のやる気を出すために 笑)

「一番弱い人が

一番可能性を持ってるんだよ。」

by 炭治郎

私の大好きな「鬼滅の刃」から

炭治郎の名言です。

え?炭治郎、アナタはホントウは何歳なの??

と思わせるような、またまた達観した発言ですが(笑)

もうホントそのとおりですよね。

ノーマークにされているヒトの方が

いらん期待とかもろもろ(笑)を背負っていません。

なので、

のびのびやれて、

期待されてたヒトよりも、案外うまくいったりします。

そう!

この人々から注目を浴びていない、期待されていない状態で

自分はめっちゃ頑張っている時って

結構パフォーマンスが自然と上がったりするんですよね。

炭治郎、どうもありがとう! (^0^)

今日もやる気が出てきました!

よし!! 今日も頑張るぞ~! お~!!

というコトで、

私もノーマークなうちに、ガンガン勉強して見返してやりますよ!笑

なので、今日もノルマはゼッタイこなします!

ではでは、いい加減まとめに入ります。笑

その前に本の目次の紹介です。

ゼロつくディープラーニングは、下記↓の合計8章で構成されています。

本の目次

- 1章 Python入門

- 2章 パーセプトロン

- 3章 ニューラルネットワーク

- 4章 ニューラルネットワークの学習

- 5章 誤差伝播法

- 6章 学習に関するテクニック

- 7章 畳み込みニューラルネットワーク

- 8章 ディープラーニング

ちなみに…

ゼロつくディープラーニングの第1章はPython入門のセクション(20ページ分)なので、

とりあえず今回私は飛ばし、第2章からまとめています。

現在は、第7章 畳み込みニューラルネットワークで~す。

第7章 畳み込みニューラルネットワーク つづき

第7章のテーマは、

畳み込みニューラルネットワーク(Convolutional Neural Network: CNN)。

7.4.4 Poolingレイヤの実装

Poolingレイヤの実装も

Convolutionレイヤと同じく、im2colを使って入力データを展開する。

PoolingレイヤのPython実装例は↓のとおり。

# 7.4.4 Poolingレイヤの実装 # Convolutionレイヤと同じく、im2colを使って入力データを展開 import numpy as np class Pooling: def __init__(self, pool_h, pool_w, stride=2, pad=0): self.pool_h = pool_h self.pool_w = pool_w self.stride = stride self.pad = pad def forward(self, x): N, C, H, W = x.shape out_h = int(1 + (H - self.pool_h) / self.stride) out_w = int(1 + (W - self.pool_w) / self.stride) #展開(1) col = im2col(x, self.pool_h, self.pool_w, self.stride, self.pad) col = col.reshape(-1, self.pool_h*self.pool_w) #最大値(2) out = np.max(col, axis = 1) #整形(3) out = out.reshape(N, out_h, out_w, C).transpose(0, 3, 1, 2) return out

ポイント!!

↑の実装で、

最大値の計算は、NumPyのnp.maxが利用できる。

たとえば、

np.max(x, axis = 1)とすると、入力xの1時限目の軸ごとに最大値が求められる。

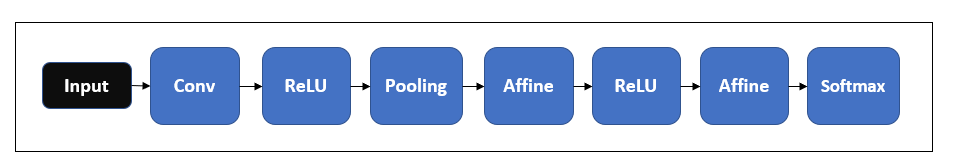

7.5 CNNの実装

単純なCNNのネットワークを構成してみる。

↓の図が例。

このCNN↑のネットワークを、SimpleConvNetというクラスで実装してみる。

まずは、

SimpleConvNetの初期化(__init__)から見ていく。

引数は次の↓のとおり。

引数

- input_dim: 入力データの(チャンネル、高さ、幅)の次元

- conv_param: 畳み込みハイパーパラメータ

- fileter_num: フィルターの数

- filter_size: フィルターのサイズ

- stride: ストライド

- pad: パディング

- hidden_size: 隠れ層のニューロンの数

- output_size: 出力層のニューロンの数

- weight_init_std: 初期化の際の重みの標準偏差

Pythonで実装すると↓のとおり。

# 7.5 CNNの実装 # 単純なCNNのネットワークを構成 # coding: utf-8 # まずはライブラリインポート import sys, os sys.path.append(os.pardir) # 親ディレクトリのファイルをインポートするための設定 import pickle import numpy as np from collections import OrderedDict from common.layers import * from common.gradient import numerical_gradient class SimpleConvNet: # ""単純なConvNet # conv - relu - pool - affine - relu - affine - softmax # Parameters # ---------- # input_size : 入力サイズ(MNISTの場合は784) # hidden_size_list : 隠れ層のニューロンの数のリスト(e.g. [100, 100, 100]) # output_size : 出力サイズ(MNISTの場合は10) # activation : 'relu' or 'sigmoid' # weight_init_std : 重みの標準偏差を指定(e.g. 0.01) # 'relu'または'he'を指定した場合は「Heの初期値」を設定 # 'sigmoid'または'xavier'を指定した場合は「Xavierの初期値」を設定 def __init__(self, input_dim =(1, 28, 28), conv_param={'filter_num':30, 'filter_size':5, 'pad':0, 'stride':1}, hidden_size = 100, output_size=10, weight_init_std=0.01): filter_num = conv_param['filter_num'] filter_size = conv_param['filter_size'] filter_pad = conv_param['pad'] filter_stride = conv_param['stride'] input_size = input_dim[1] conv_output_size = (input_size - filter_size + 2*filter_pad) / filter_stride + 1 pool_output_size = int(filter_num * (conv_output_size/2) * (conv_output_size/2)) #重みの初期化 self.params = {} self.params['W1'] = weight_init_std * \ np.random.randn(filter_num, input_dim[0], filter_size, filter_size) self.params['b1'] = np.zeros(filter_num) self.params['W2'] = weight_init_std * \ np.random.randn(pool_output_size, hidden_size) self.params['b2'] = np.zeros(hidden_size) self.params['W3'] = weight_init_std * \ np.random.randn(hidden_size, output_size) self.params['b3'] = np.zeros(output_size) #レイヤの生成 self.layers = OrderedDict() self.layers['Conv1'] = Convolution(self.params['W1'], self.params['b1'], conv_param['stride'], conv_param['pad']) self.layers['Relu1'] = Pooling(pool_h=2, pool_w=2, stride=2) self.layers['Affine1'] = Affine(self.params['W2'], self.params['b2']) self.layers['Relu2'] = Relu() self.layers['Affine2'] = Affine(self.params['W3'], self.params['b3']) self.last_year = SoftmaxWithLoss() def predict(self, x): for layer in self.layers.values(): x = layer.forward(x) return x def loss(self, x, t): """損失関数を求める 引数のxは入力データ、tは教師ラベル """ y = self.predict(x) return self.last_layer.forward(y, t) def accuracy(self, x, t, batch_size=100): if t.ndim != 1 : t = np.argmax(t, axis=1) acc = 0.0 for i in range(int(x.shape[0] / batch_size)): tx = x[i*batch_size:(i+1)*batch_size] tt = t[i*batch_size:(i+1)*batch_size] y = self.predict(tx) y = np.argmax(y, axis=1) acc += np.sum(y == tt) return acc / x.shape[0] def numerical_gradient(self, x, t): """勾配を求める(数値微分) Parameters ---------- x : 入力データ t : 教師ラベル Returns ------- 各層の勾配を持ったディクショナリ変数 grads['W1']、grads['W2']、...は各層の重み grads['b1']、grads['b2']、...は各層のバイアス """ loss_w = lambda w: self.loss(x, t) grads = {} for idx in (1, 2, 3): grads['W' + str(idx)] = numerical_gradient(loss_w, self.params['W' + str(idx)]) grads['b' + str(idx)] = numerical_gradient(loss_w, self.params['b' + str(idx)]) return grads def gradient(self, x, t): """勾配を求める(誤差逆伝搬法) Parameters ---------- x : 入力データ t : 教師ラベル Returns ------- 各層の勾配を持ったディクショナリ変数 grads['W1']、grads['W2']、...は各層の重み grads['b1']、grads['b2']、...は各層のバイアス """ # forward self.loss(x, t) # backward dout = 1 dout = self.last_layer.backward(dout) layers = list(self.layers.values()) layers.reverse() for layer in layers: dout = layer.backward(dout) # 設定 grads = {} grads['W1'], grads['b1'] = self.layers['Conv1'].dW, self.layers['Conv1'].db grads['W2'], grads['b2'] = self.layers['Affine1'].dW, self.layers['Affine1'].db grads['W3'], grads['b3'] = self.layers['Affine2'].dW, self.layers['Affine2'].db return grads def save_params(self, file_name="params.pkl"): params = {} for key, val in self.params.items(): params[key] = val with open(file_name, 'wb') as f: pickle.dump(params, f) def load_params(self, file_name="params.pkl"): with open(file_name, 'rb') as f: params = pickle.load(f) for key, val in params.items(): self.params[key] = val for i, key in enumerate(['Conv1', 'Affine1', 'Affine2']): self.layers[key].W = self.params['W' + str(i+1)] self.layers[key].b = self.params['b' + str(i+1)]